머신러닝에 대해서는 아래의 유튜브를 통해 학습하였다.

Gradient Descent (경사 하강법)

경사 하강법은 머신 러닝과 최적화 알고리즘에서 매개변수를 조정하여 함수의 최솟값을 찾는 기법이다. 주어진 함수의 기울기를 활용하여 최적의 매개변수 값을 찾아가는 방법이다.

경사 하강법은 일반적으로 손실 함수를 최소화하는데 사용된다. 손실 함수는 모델의 예측값과 실제값 사이의 차이를 나타내는 함수로, 모델의 성능을 평가하는 지표이다. 경사 하강법은 손실 함수의 기울기를 따라 가장 빠르게 감소하는 방향으로 매개변수를 업데이트하여 최적의 매개변수 값을 찾아낸다.

경사 하강법에서 매개변수는 일반적으로 2가지가 있다.

- 학습률 (learing rate): 평가 하는 데이터의 보폭, 일반적으로 (0.001, 0.003, 0.01, 0.03, 0.1, 0.3)을 사용

- 에포크 (Epoch): 모델이 전체 학습 데이터를 몇번 반복해서 학습할지 결정하는 파라미터

실습

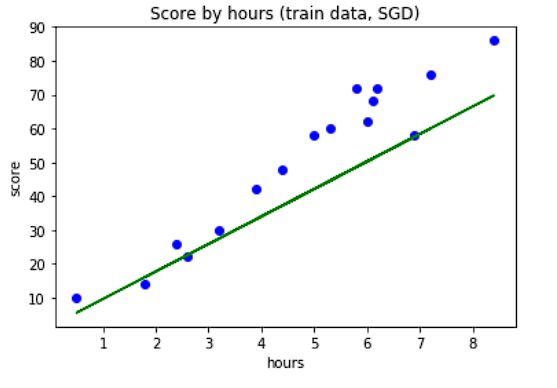

실습은 데이터 세트 분리에서 사용했던 데이터를 계속해서 사용한다.

위는 기본값으로 Epoch와 학습률을 설정했을 때의 결과이다. 한번 Epoch값을 100으로 설정하고 학습률을 좀 더 줄여서 더 짧은 보폭으로 데이터를 탐색하게 해 보겠다.

그래프가 변화가 된게 확인이 된다. 그 이유는 위쪽에 있는 빨간색으로 표시된 경고문 때문이다. 학습률이 높아지면서 Epoch의 횟수 또한 늘어나야 한다. 하지만 Epoch의 횟수가 100 밖에 안됨으로 횟수를 더 늘려야 한다는게 경고문의 내용이다.

위의 그래프는 Epoch의 횟수를 200으로 늘린 결과의 그래프이다. 확연하게 결과가 좋아진것을 확인할 수 있다.

'인공지능 > Machine Learning' 카테고리의 다른 글

| 1-2. 데이터 세트 분리 (0) | 2023.05.09 |

|---|---|

| 1-1. Linear Regression (0) | 2023.05.09 |

| Machine Learning의 분류 (0) | 2023.05.08 |